Überlegungen zum Design des Thermo-Infrarotsensors für die Gegen-UAS-Verteidigung

Kurzfassung

Der Einsatz von kleinen, kostengünstigen Drohnen hat sich in militärischen und öffentlichen Sicherheitsumgebungen schnell ausgeweitet und schafft einen dringenden Bedarf an effektiven C-UAS-Lösungen (Counter-Unmanned Aerial System). Dieses Dokument beschreibt, wie EO/IR-Sensoren das Rückgrat der C-UAS-Kill-Kette bilden, und vergleicht die Kompromisse zwischen kostengünstigen Bildgebungssystemen und leistungsstarken Multisensorarchitekturen. Sie hebt die Herausforderungen der Fernbereichserkennung hervor, bei der Drohnen nur als wenige Pixel auftreten können und die Leistung durch das Signal-Rausch-Verhältnis (SNR) eingeschränkt ist. Die Arbeit unterstreicht auch die Einschränkungen der klassischen MTI- und KI-basierten Objekterkennung am Rande der Sichtbarkeit. Schließlich unterstreicht es die wesentliche Rolle der fortschrittlichen Bildsignalverarbeitung (ISP) bei der Verbesserung des SNR, der Stabilisierung von kontrastarmen Zielen und der Erweiterung des effektiven Erkennungs- und Verfolgungsbereichs.

Einführung und Hintergrund

Die Bedrohung durch Drohnen entsteht in taktischen und öffentlichen Sicherheitsszenarien. Die Verbreitung kleiner, kostengünstiger und manövrierfähiger Drohnen stellt sowohl für Militärplaner als auch für den Schutz öffentlicher, kommerzieller und industrieller Schwachstellen eine große Herausforderung dar. Es ist nicht übertrieben zu behaupten, dass es ein Waffenrennen zwischen anstößigen Drohnen und C-UAS-Lösungen gibt.

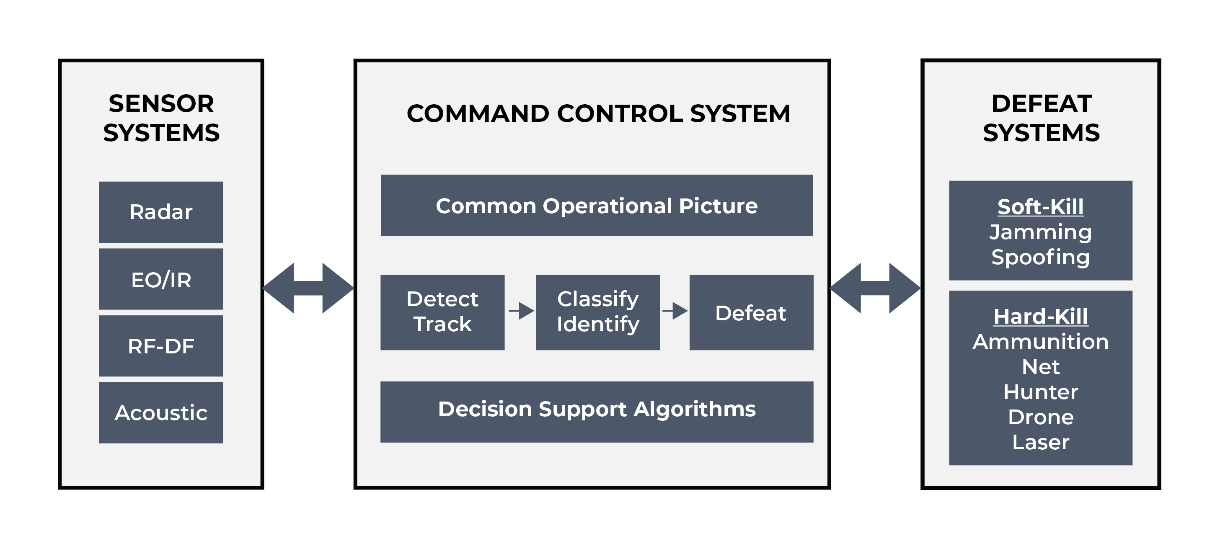

Elektrooptische (EO) und thermische Infrarot (IR) Bildgebung sind zu Kerntechnologien für die Erkennung und Verfolgung von Drohnen geworden. Um eine Kosten-Nutzen-Analyse durchzuführen, müssen Entwickler den Handelsraum von C-UAS-Systemen verstehen, einschließlich Erfassungsbereichsbeschränkungen, Radarsystemfunktionen, Bildsignalverarbeitung, eingebettete Prozessoren und KI-Modelle (Artificial Intelligence). Obwohl jedes Luftverteidigungssystem gegen eine bestimmte Reihe von Luftbedrohungen entwickelt wurde, bestehen ihre Kill-Chains in der Regel alle aus drei komplexen Subsystemen: Sensorsysteme, Befehlssteuerungssystem und Abschaltsysteme.

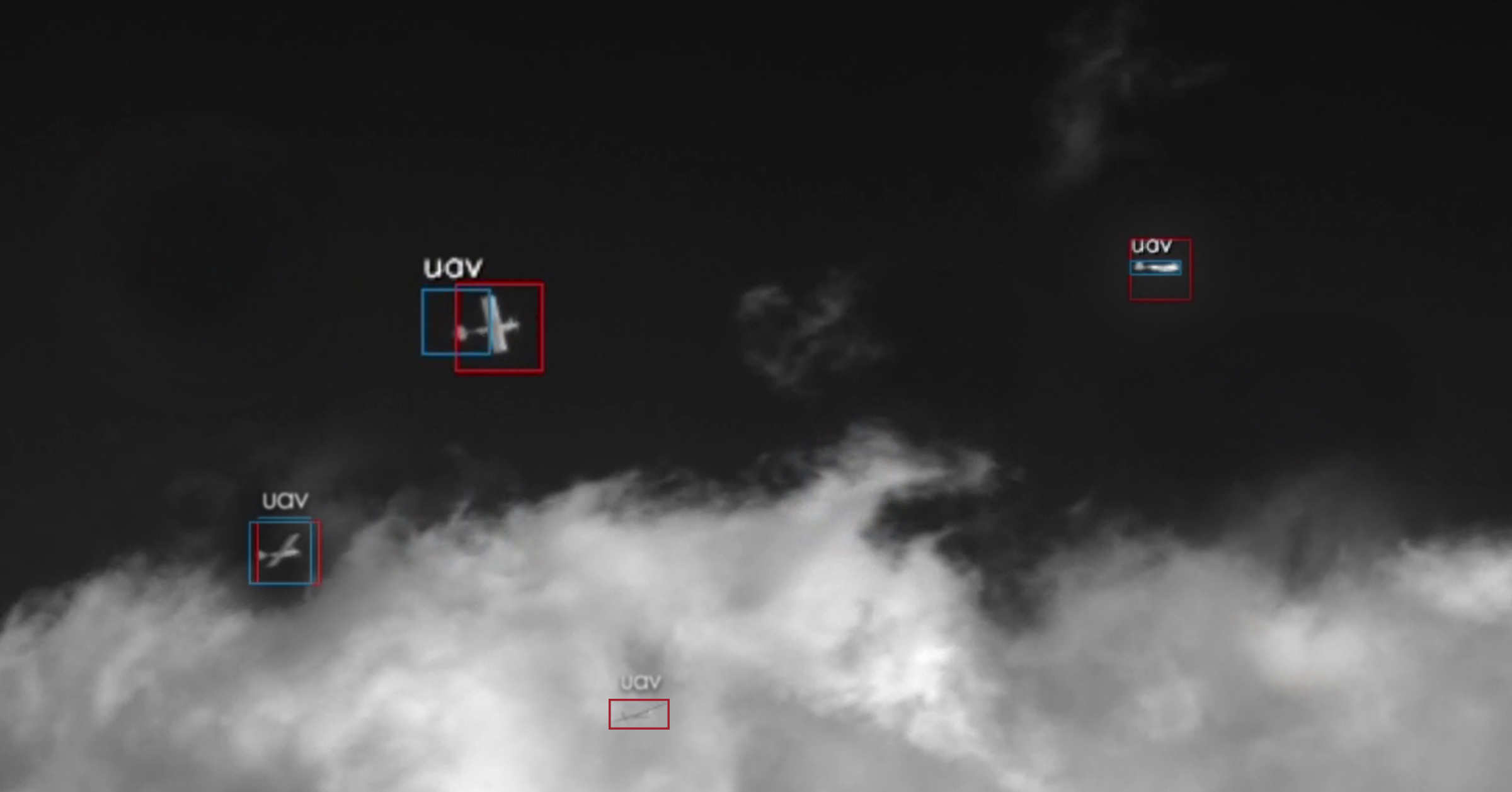

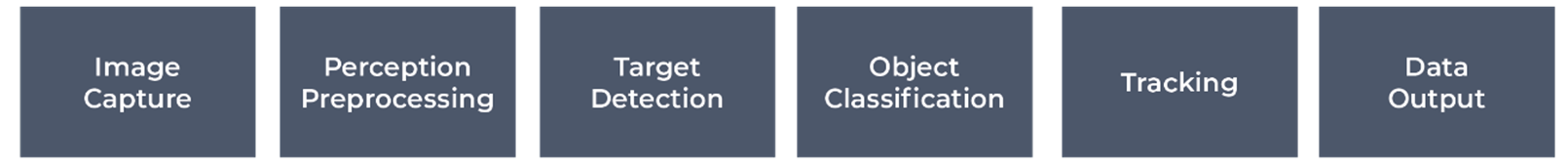

Abbildung 1. C-UAS-Prozess zum Erkennen, Verfolgen, Identifizieren und Neutralisieren von Drohnen

Der russisch-ukrainische Krieg ist zu einem Tiegel für UAS-Innovationen geworden und beschleunigt die Fähigkeiten und Taktiken von Drohnen. Obwohl Defeat-Systeme wie Funkstau, GPS-Signalstau und kinetische Effektoren entlang der Schlachtlinien eingesetzt werden, sind diese Systeme teuer und werden nur begrenzt in öffentlichen Sicherheitsanwendungen eingesetzt.

EO/IR-Bildgebungssysteme zur Drohnenerkennung

Kostengünstige elektrooptische Sensoren (EO) bieten eine hohe Auflösung und Linsen mit geeigneter Brennweite. Passive Infrarotsensoren (IR-Sensoren) reagieren empfindlich auf thermische Photonenemissionen anstelle von sichtbarem Licht und machen IR ideal für den Dauerbetrieb. EO-Kameras haben eine höhere Winkelauflösung, die sich direkt in Pixel auf dem Ziel übersetzt: Dies ist ein kritischer Systemparameter für die frühe Drohnenerkennung. Das SNR der EO-Pixel bei einer kleinen Drohne ist jedoch aufgrund des begrenzten Kontrasts gegen einen Himmelhintergrund oft niedrig. IR-Kameras können häufig Drohnenbewegungen erkennen, die durch ein 2x2-Pixel-Cluster dargestellt werden, wenn der kalte Hintergrund des Himmels berücksichtigt wird. Darüber hinaus helfen Klassifizierungshinweise, einschließlich Form, Bewegungsmuster und thermische Signaturen, IR, Drohnen von Vögeln, Flugzeugen und Unordnung zu unterscheiden, um falsch positive Ergebnisse zu minimieren, was oft die Wirksamkeit von Bildgebungssystemen verringert.

Überlegungen zum C-UAS-Lösungsdesign

C-UAS-Erkennungssysteme fallen in zwei separate Kosten- und Leistungskategorien: niedrigere Kosten und hohe Leistung. Kostengünstige, nur bildgebende Erkennungssysteme mit einer Drohnenerkennungsdistanz von < 1000 Metern integrieren ungekühlte EO- und Longwave IR (LWIR)-Sensoren mit Linsen mit fester Brennweite und Kosten zwischen 50.000 und 150.000 USD. Diese Systeme sind typischerweise auf ein festes Sichtfeld (FOV) oder ein horizontales Scannen von 90 bis 180 Grad beschränkt, was für die Umfangsüberwachung nützlich ist. Fortschrittliche, leistungsstarke Multisensor-Detektionssysteme mit einer Reichweite von > 1000 Metern umfassen EO- und gekühlte Midwave IR (MWIR)-Kameras mit kontinuierlicher Zoom-(CZ)-Optik und Radar. Diese Systeme kosten zwischen 150.000 und 1 Mio. USD und können so konfiguriert werden, dass sie ein vollständiges 360-Grad-FOV für maximale Situationswahrnehmung bereitstellen.

Kostengünstigere C-UAS-Lösungen umfassen in der Regel Folgendes:

- EO- und ungekühlte LWIR-Infrarotkameras mit langer Brennweite oder Zoomoptik

- Feste oder Schwenk- und Kippmontage

- Eingebetteter Computer zur Objekterkennung und -verfolgung

- Niederschlagssystem, typischerweise RF-Störung

Zu den leistungsstarken C-UAS-Lösungen gehören in der Regel:

- EO- und gekühlte MWIR-Kameras mit CZ-Langstreckenoptik

- Schwenken und neigen oder stabilisieren Sie die kardanische Aufhängung auf stationären oder mobilen Plattformen mit ausfahrbaren Masten

- Hochauflösende Weitbereichs-Radareinheiten für Kamera-Slew-to-Cue

- Akustische Sensoren

- Server- oder PC-basiert

- Besiege Systeme – alle Arten, einschließlich Kinetik

Abbildung 2. Kostengünstiger C-UAS

Abbildung 2. Kostengünstiger C-UAS

Bei der Auswahl einer EO-Kamera müssen viele Spezifikationen berücksichtigt werden: Farbe versus Schwarzweiß, Auflösungen von bis zu 200MP und Rolling versus Global Shutter. Es gibt Trades auf Systemebene für Pixelrate, integrierte Edge-Signalverarbeitung, Bitrate, Empfindlichkeit und Objektivauswahl. EO-Systeme bieten 2- bis 8-mal mehr Auflösung und Pixel auf dem Ziel als eine IR-Kamera, aber die Leistung des Erfassungsbereichs ist eine Funktion von SNR.

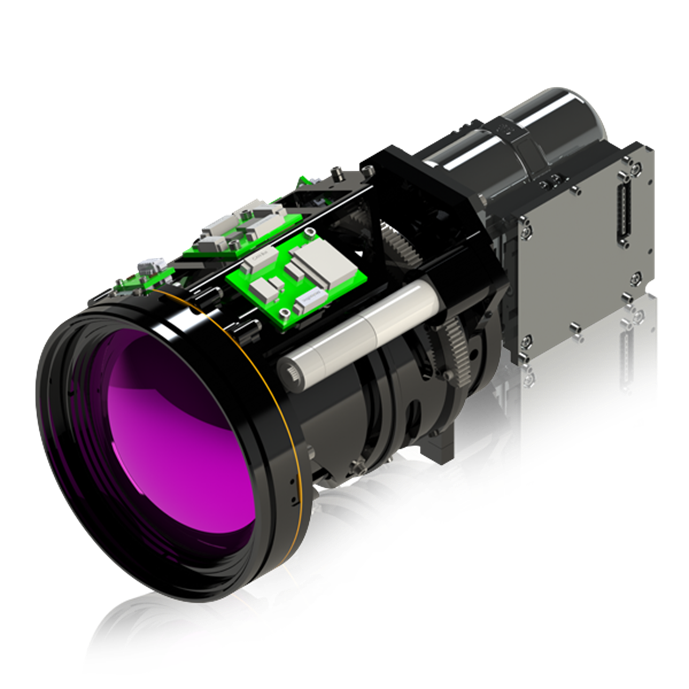

Abbildung 3. Fest 73 mm LWIR (links), 14-75 mm CZ LWIR (Mitte), 15-300 mm CZ MWIR (rechts)

Bei der Auswahl einer nicht gekühlten LWIR-Thermokamera spezifizieren die meisten Systeme einen 640x512-Auflösungssensor mit einer thermischen Empfindlichkeit von weniger als oder gleich (≤)20 Millikulvin (mK) und einer schnellen Optik, die durch eine f-Zahl zwischen ƒ0,9 und ƒ1,4 spezifiziert ist. Dies führt zu einer Linsenöffnung (Durchmesser), die nahezu gleich der Brennweite ist, aber es gibt eine praktische Größenbegrenzung für längere Brennweiten und Zoombereiche. Es gibt auch einen Kosten-Crossover-Punkt von ungekühltem LWIR zu gekühltem MWIR bei Brennweiten von mehr als etwa 250 mm.

Die heutigen MWIR-Systeme verfügen über kompakte Kühlboxen mit geschlossenem Zyklus und einer mittleren Ausfallzeit (MTTF) von bis zu 27.000 Stunden, die bei geringer Leistung betrieben werden. Da diese Sensortechnologie viel empfindlicher als ungekühltes LWIR ist, kann eine Optik von nur 5,5 ƒ verwendet werden, die Brennweite von mehr als 1000 mm ermöglicht und gleichzeitig die Linsenbaugruppe auf eine überschaubare Größe und Kosten reduziert. Die gekühlten MWIR-Sensoren von heute haben 8 Mikron Pixel mit Auflösungen von bis zu 1280 x 1024 und einer Empfindlichkeit von 30 mk.

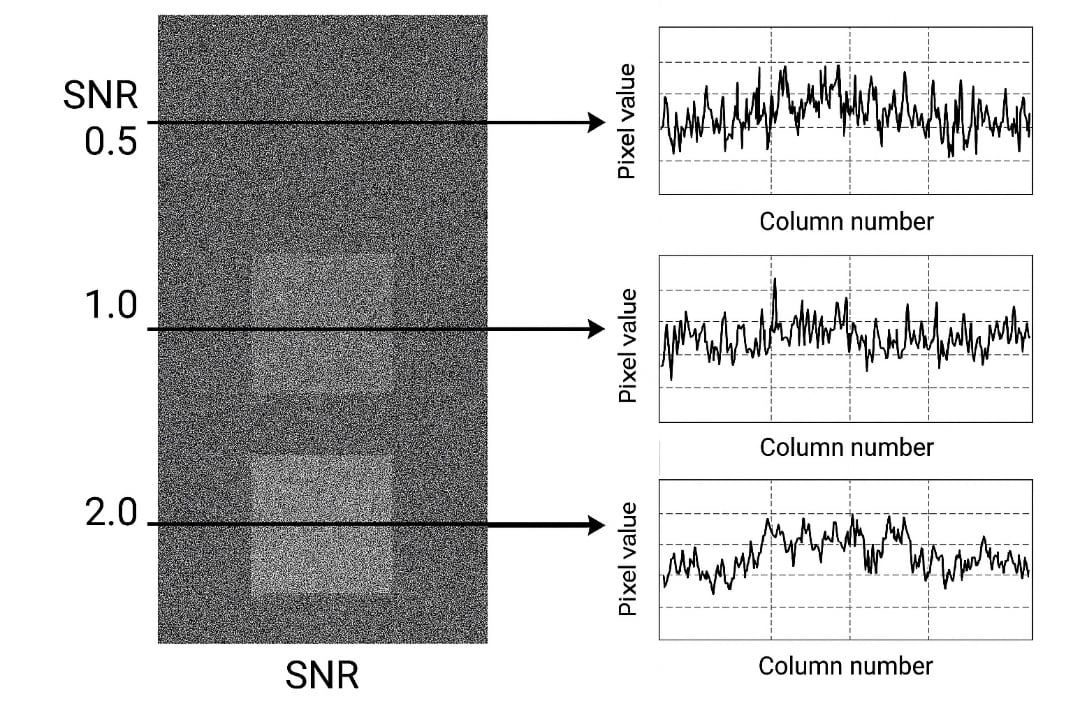

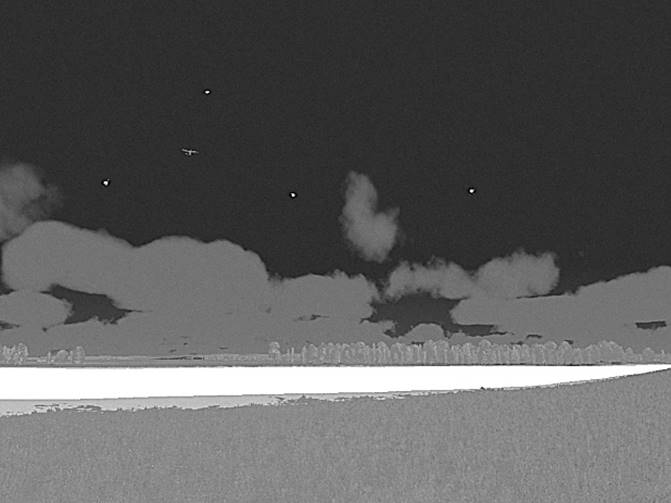

EO/IR-Anzeige für bewegliches Ziel bei niedrigem SNR

EO/IR C-UAS-Systeme verwenden Moving Target Indication (MTI)-Algorithmen als erste Stufe unter Verwendung von Techniken wie Frame-Differenzierung oder zeitliche Differenzierung und Hintergrundsubtraktion. In der Nähe der Erfassungsgrenze ist das Rauschen nicht von der Bewegung zu unterscheiden, und Rauschschwankungen auf Pixelebene können wie kleine bewegliche Objekte von Frame zu Frame aussehen, insbesondere bei hoher Verstärkung oder geringem Licht. Hintergrundbewegungen, einschließlich sich bewegendes Blattwerk, Wolken, Wasser, Hitzeschimmer und Schatten, erzeugen „falsche Bewegungen“. Die Erhöhung der Erkennungsschwellen hält Fehlalarme überschaubar, kann aber unverhältnismäßig echte Erkennungen am Rande der Sichtbarkeit unterdrücken.

Abbildung 4. Beispiel SNR-Grafik

MTI-Erkennungen unterliegen signifikanten falsch positiven Ergebnissen. Es ist eine gute Praxis, MTI-Nachweisungen zu akkumulieren und Nachweise in einer Hierarchie zu quantifizieren. Der Benutzer kann dann bestimmen, wie empfindlich das System im Vergleich zu Früherkennungen und akzeptablen falsch positiven Ergebnissen sein sollte. Die Kamera erzeugt viele laute „Blobs“ oder Mikrospuren, die bestätigt werden müssen. Im Betrieb fungiert MTI an der Erfassungsgrenze oft als Kandidatengenerator für einen KI-Objektdetektor und Zieltracker.

Zielerkennung und -verfolgung mit EO/IR-Objektdetektoren

Deep Learning, KI-basierte Objektdetektoren werden häufig für die Drohnenerkennung in EO/IR-Videosystemen verwendet und können der gleichen Ontologie folgen wie die menschlichen Wahrnehmungsklassen Erkennung, Erkennung und Identifizierung. Sie umfassen die Extraktion von Multiskalen-Funktionen:

- Erkennung (>10x10 Pixel): Generalisierte Klassifikatoren (Drohne vs. Vogel vs. Flugzeug) und Lokalisierung (Grenzfeld) für kleine bis große Ziele basierend auf begrenzten Trainingsdaten

- Erkennung (~20x10 Pixel): Feinkörnige Klassifikatoren für Zielklassen wie Quadcopter, Festflügeldrohne und Luftflugzeuge

- Identifikation (~30x20 Pixel): Feinkörnige Klassifikatoren basierend auf umfangreichen hochauflösenden Trainingsdaten von anwendungsspezifischen Klassen wie Shahed, Quadcopter-Markierung und -Modell sowie festen Flügel-Lotterzielen

Abbildung 5. Video-Pipeline zur Drohnenerkennung

Nachweisgrenzen für EO/IR

Bei Drohnen mit großer Reichweite ist die EO/IR-Leistung oft SNR- und auflösungsbegrenzt, wodurch das System gezwungen wird, nahe der Nachweisgrenze zu arbeiten. Für einen kleinen Quadcopter oder eine Festflügeldrohne kann die Winkelgröße bei großer Reichweite nur wenige Pixel oder sogar Subpixel betragen. An diesem Punkt ist die scheinbare Größe der Drohne vergleichbar mit oder kleiner als die Punktspreizfunktion (PSF) der Optik. Atmosphärische Effekte, einschließlich Streuung, Trübung und Turbulenz, können den Kontrast weiter reduzieren und zufällige Unschärfe verursachen. Die Bestimmungsgrenze entspricht häufig:

- SNR: Niedriges SNR (1–3) auf Pixel- oder Small-Patch-Ebene

- Bereich: Sehr kleine sichtbare Fläche (<20 pixel>

- Hintergrund: Intermittierende Sichtbarkeit, wenn die Drohne komplexe Hintergründe überquert, z. B. Bäume, Gebäude, Wolken usw.

Die meisten Objektdetektoren verschlechtern sich stark, wenn das Objekt unter etwa 10×10 Pixeln liegt. Bei 3×3 oder bis zu 5×5 Pixeln verfügt das Netzwerk über sehr wenige Details, Formhinweise sind begrenzt, Textur ist nicht vorhanden und es bleibt nur grobe Bewegung/Kontrast. Wenn das Netzwerktraining keine sehr kleinen, lauten Ziele enthält, verpasst der Detektor Ziele oder erzeugt instabile Ausgänge. Detektoren, die unter Verwendung sauberer Tagbilder, spezifischer Hintergründe und starker Kontrastziele trainiert werden, können bei schlechten Licht- oder Nachtverhältnissen, Trübung oder Feuchtigkeit und Hintergrundvariationen, z. B. Wüste vs. urban vs. maritimen Bedingungen, besonders herausgefordert werden oder versagen.

An der Nachweisgrenze wird jede Diskrepanz zwischen Trainings- und Bereitstellungsverteilungen vergrößert. Die Verfahren zur Kennzeichnung von Schulungsdaten und Anmerkungen sind für sehr kleine Ziele sehr wichtig. Manuelle Anmerkungen können anfällig für Fehler sein. Begrenzungsboxen entsprechen möglicherweise nicht dem tatsächlichen Ziel und verfehlen Ziele möglicherweise vollständig im extremen Bereich. Dies führt zu Etikettengeräuschen, die den Detektor verwirren und seine Fähigkeit einschränken können, feine Unterscheidungen bei niedrigem SNR zu lernen.

Darüber hinaus beinhalten Trainingsdaten selten Beispiele für kleine, stark verschwommene Drohnen; die meisten CNN-Netzwerke sind auf scharfe oder mäßig verschwommene Ziele ausgerichtet. Verschwommene und Kamerabewegungen sind große Einschränkungen bei der Erkennung von EO/IR-Drohnen, insbesondere bei großen Reichweiten oder auf beweglichen Plattformen. Tracking-by-Detection-Pipelines basieren auf Erkennungen, die in Position und Größe konsistent sind. Blur verursacht Jitter- und Größenvariabilität, wodurch die Datenzuordnung unterbrochen wird. Klassische Tracker, z. B. KLT-Funktionen oder Vorlagenabgleich, haben Schwierigkeiten, wenn sich das interne Erscheinungsbild der Vorlage aufgrund von Weichzeichnungsrichtung und -größe drastisch ändert.

Abbildung 6. Synthetische Simulation von EO/IR mit festem Flügel und Quadkoptern im Bereich

Um die Leistung zu verbessern, können Entwicklungsteams Datenaugmentation verwenden, einschließlich Skalierung, Rauschinjektion, Unschärfe und Beleuchtungsänderungen. Das Training auf synthetischen Daten ermöglicht das Rendern von Drohnenmodellen in realistische Hintergründe und negative Beispiele für Vögel, Flugzeuge und Unordnung. Multiframe- oder spurenbewusste Detektoren können mit Sequenzen anstelle von Einzelframes verwendet werden.

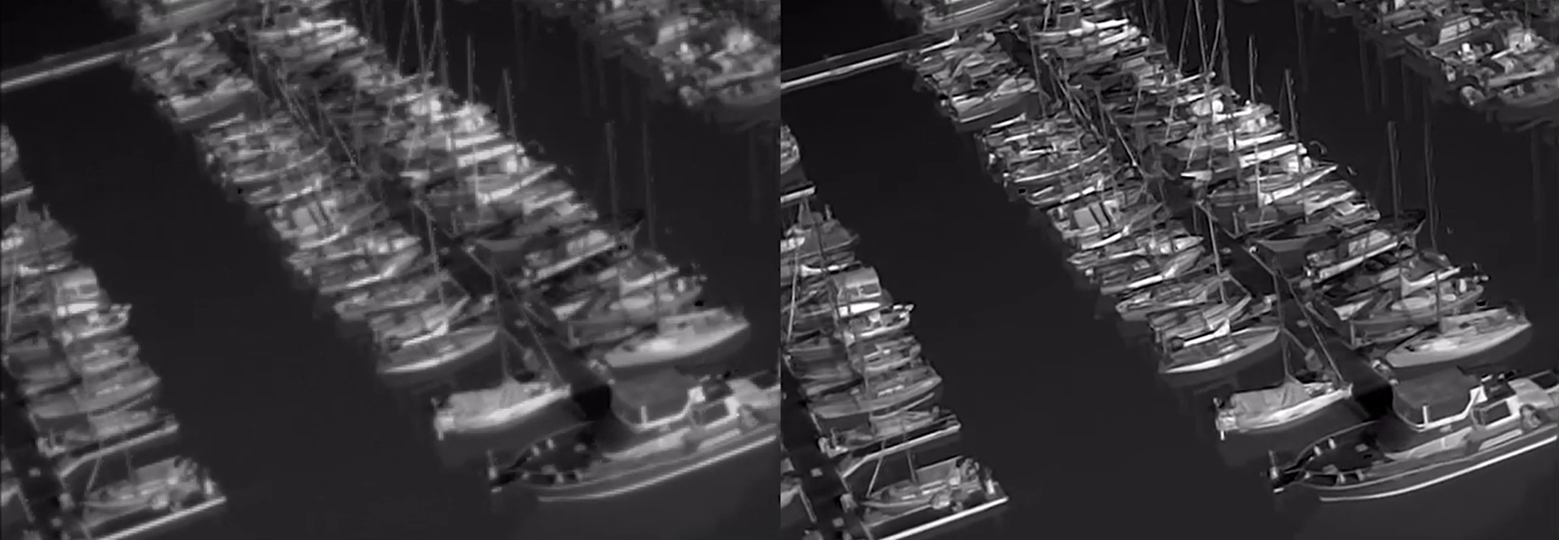

Verarbeitung von EO/IR-Bildsignalen

ISP für EO/IR-Kamerasysteme bezieht sich auf den Satz von Algorithmen und Hardwarefunktionen, die rohe Sensordaten in nutzbare, hochwertige Bilder umwandeln, die Erkennung, Erkennung, Identifizierung, Messung und automatisierte Entscheidungsfindung unterstützen. In EO/IR-Systemen, insbesondere thermischen IR-Kameras, ist die Rohausgabe von der Focal Plane Array (FPA) laut, nichtlinear und unkorrigiert. ISP wandelt diese Rohdaten in Echtzeit in stabile, kalibrierte, visuell optimierte Bilder um. SNR und Netzwerkleistung und -zuverlässigkeit hängen von der Qualität des ISP ab, um die Zielerkennung, -erkennung und -identifizierung (DRI) zu verbessern. Teledyne FLIR OEM hat IR ISP-Algorithmen entwickelt, um das SNR und an den Erkennungsgrenzen (~2x1,5 Pixel) zu verbessern, die den Bereich erhöhen, um die Drohnenverfolgung um bis zu 20 % zu initiieren. Um mehr zu erfahren, besuchen Sie bitte www.oem.flir.com/prism-family.

Abbildung 7. Teledyne FLIR OEM ISP Super Resolution Beispiel